Dream2Flow 用 3D 物体流连接视频生成与开放世界操作

Paper Project Page Code

1. 作者研究了什么问题? 🎯

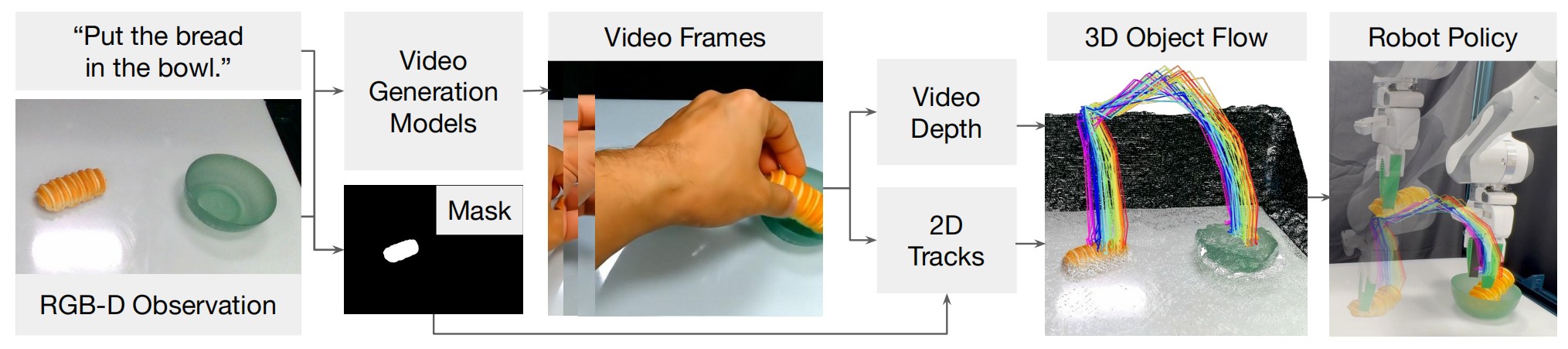

这篇工作引入了 Dream2Flow 框架,通过 3D 物体流作为中间表示,成功桥接了视频生成与机器人控制这两个原本不直接兼容的领域。

2. 为什么做这件事情?研究背景与意义是什么? 🔍

2.1 研究背景

- 视频生成模型:擅长合成人类交互的视觉预测,但输出仅限于像素空间的视频

- 机器人操控:需要低级别的关节命令或末端执行器姿态,与视频生成模型的输出形式不兼容

- 具身差距(Embodiment Gap):视频模型生成的是人类手的动作,而机器人具有不同的形态(臂、手、夹持器等),直接模仿人类动作会因运动学/动力学约束而失败

2.2 研究意义

- 解决视频生成模型与机器人操控之间的具身差距

- 实现从预训练视频模型的零样本指导,操作不同类别的物体

- 提供一个通用、可扩展的接口,适配视频生成模型到开放世界的机器人操作

3. 用了什么方法?每一步的逻辑是什么? 📋

3.1 核心技术路径

- 重建3D物体运动:从生成的视频中提取物体的3D轨迹(而非2D光流或刚性变换)

- 操控形式化为轨迹跟踪:机器人的任务不再是”模仿人类动作”,而是”让物体跟随生成的3D流”

- 转换为可执行控制:通过轨迹优化或强化学习,将重建的3D物体流转换为可执行的底层控制,无需任务特定的演示

3.2 实现路径

- 轨迹优化:直接优化机器人动作以最小化物体轨迹跟踪误差(用于Push-T、真实世界任务)

- 强化学习:将3D物体流作为奖励函数训练策略(用于Open Door任务)

4. 难点在哪里?作者是如何突破的? 🚧

4.1 核心难点

- 具身差距:视频生成模型与机器人操控系统之间的形态差异导致直接模仿人类动作失败

- 多物体类型适配:不同类型物体(刚性、关节式、可变形、颗粒状)的运动特性差异大

- 零样本泛化:在无任务特定演示的情况下,实现对新任务和新物体的操控

4.2 突破方法

- 分离状态变化与执行实现:聚焦于物体的最终运动状态,而非实现该状态的具体动作,使方法跨机器人形态通用

- 3D物体流作为中间表示:将视频中的视觉信息转化为结构化的3D轨迹,作为连接视频生成与机器人控制的桥梁

- 通用轨迹跟踪框架:通过轨迹优化或强化学习,将3D物体流转化为适用于不同机器人系统的底层控制命令

5. 解决了什么问题? ✅

- 具身差距问题:通过分离状态变化与执行器实现,克服了视频生成模型与机器人操控之间的形态差异

- 零样本指导问题:实现了从预训练视频模型的零样本指导,无需任务特定的演示数据

- 物体多样性问题:成功操作多种类型的物体,包括刚性(如面包、杯子)、关节式(如烤箱门、抽屉)、可变形(如围巾、布料)和颗粒状(如意大利面、沙子)

- 通用性与可扩展性问题:3D物体流作为通用接口,可适配不同的视频生成模型和下游操控系统

6. 实验结论 📊

6.1 3D物体流的价值

- 通用性:适用于多种任务、物体类型和机器人形态

- 可扩展性:作为接口,可以适配不同的视频生成模型和下游操控系统

- 开放世界操控:在未见过的环境和任务中工作,无需任务特定数据

6.2 验证结果

模拟环境和真实世界的实验都证明了 3D 物体流作为一个通用的可扩展接口,能够有效适配视频生成模型到开放世界的机器人操作。

7. 核心贡献总结 🌟

- 问题识别:明确指出视频生成模型与机器人操控之间存在具身差距

- 创新解决方案:提出3D物体流作为中间表示,分离状态变化与执行方式

- 技术实现:从视频重建3D运动,将操控形式化为轨迹跟踪问题

- 能力验证:实现零样本指导,支持多种物体类型,跨机器人形态通用

- 实验验证:模拟和真实实验证明其通用性和可扩展性